Что такое ChatGPT: простое объяснение для неспециалистов

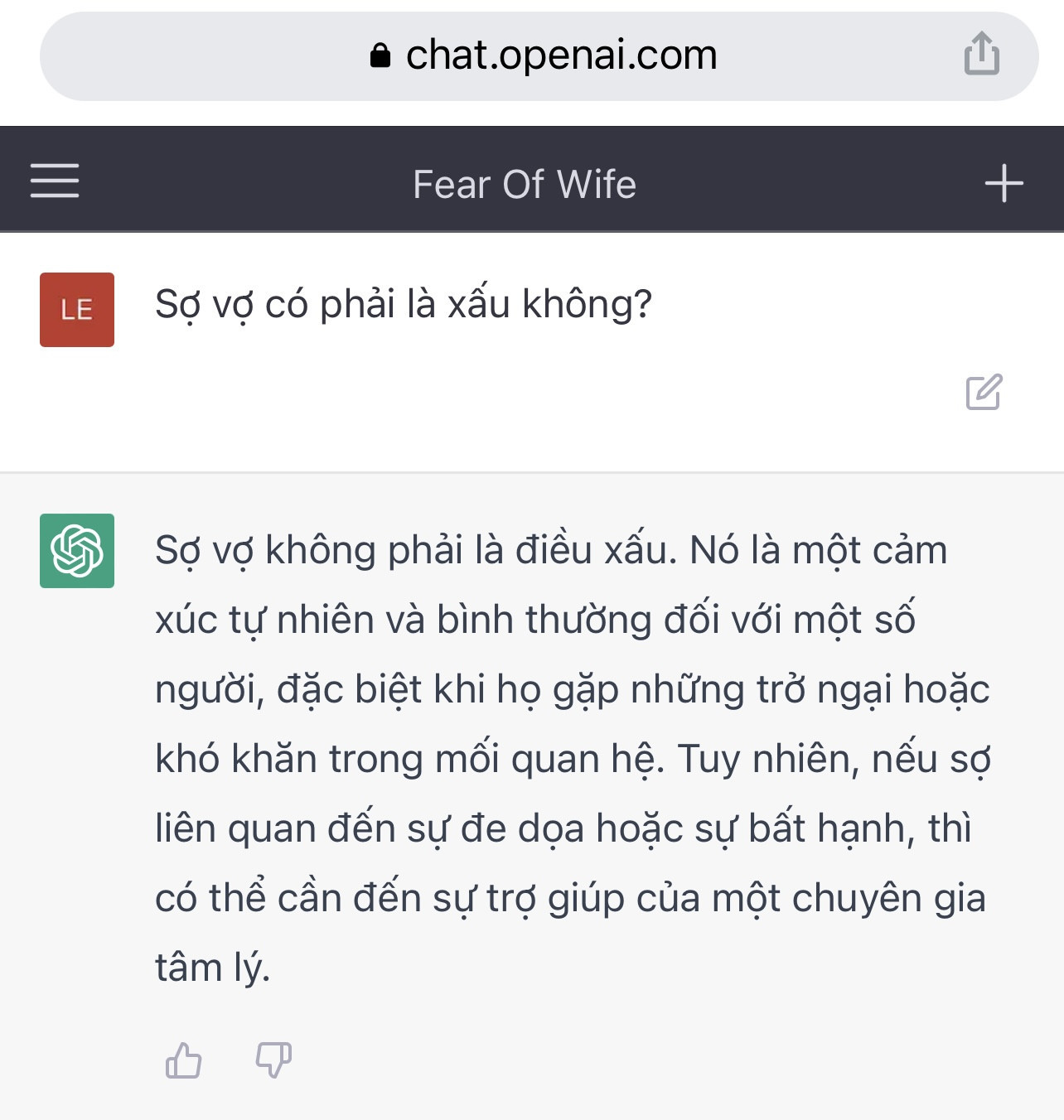

Для обычного пользователя ChatGPT — это просто сайт, где можно общаться и обсуждать любые темы с виртуальным ботом.

ChatGPT в настоящее время является одним из самых популярных ключевых слов в социальных сетях. Однако не все могут ясно понять природу этой программы искусственного интеллекта. Ниже газета VietNamNet предлагает читателям статью эксперта по безопасности Нгуена Хонг Фука о ChatGPT, чтобы доступно объяснить её тем, кто не разбирается в технологиях.

Простое понимание ChatGPT

Для обычного пользователя ChatGPT — это просто сайт, где можно общаться и обсуждать любые темы с виртуальным ботом.

Этот бот был создан компанией OpenAI, основанной Илоном Маском в 2015 году, с первоначальной миссией «предотвращения опасностей ИИ».

Как создается ChatGPT?

ChatGPT — это компьютерная программа искусственного интеллекта. Технически её часто называют Model AI, по-вьетнамски это означает «модель данных искусственного интеллекта», но по сути это всё ещё цифровые данные, обрабатываемые компьютером, поэтому называть её программой не будет ошибкой.

Слово «модель ИИ» состоит из двух частей: «модель данных» (Model, Data Model) и «ИИ» (Artificial Intelligence, AI). Буквальное значение: «Интеллект возникает из данных», что означает, что чем больше данных, тем выше интеллект.

Процесс создания модели ИИ состоит из следующих этапов: сбор данных, выбор данных, маркировка данных для обучения и обучение.

Обучать ИИ в принципе просто, как в этом диалоге:

Вопрос: Как вас зовут?

Ответ: Меня зовут ChatGPT.

Вопрос: Что такое VietNamNet?

Ответ: VietNamNet — электронная газета во Вьетнаме.

Затем мы обучаем ИИ запоминать эту информацию (обучение), затем сохраняем запомненную информацию в мозге ИИ как модель ИИ (контрольную точку модели). В дальнейшем, при использовании, загружаем память, содержащую эту информацию (вывод), в компьютер. Вам просто нужно задать соответствующий вопрос, и ИИ запомнит полученные знания и ответит «точно тому, чему его научили».

Фактически, за последние десятилетия ИИ специализировался на множестве конкретных задач, таких как: ИИ для поддержки авиастроения, ИИ для моделирования боевых действий, ИИ в играх... но практически ни одна крупная компания не инвестировала в ИИ в сфере лингвистики. Только в 2017 году произошёл технологический прорыв, который значительно повысил эффективность обучения с помощью ИИ, особенно в области лингвистики.

Язык, а именно письменность, – это достижение, которое создало человеческую цивилизацию. Люди облекают свои знания в письменную форму. Понимание языка (письма) – это понимание человеческих знаний. Это ключевой момент, лежащий в основе создания лингвистического ИИ. До 2017 года людям было очень сложно заставить компьютеры понимать смысл осмысленного предложения.

Так что же нас ждет в 2017 году?

В августе 2017 года ученые Google, а точнее подразделения Google Brain, которое с 2011 года занимается исследованиями в области искусственного интеллекта, изобрели алгоритм под названием Transformer (название алгоритма очень похоже на известный в кинематографе фильм «Битвы роботов»).

Алгоритм Transformer — это прорыв, особенно в области обучения ИИ языку. До появления этого алгоритма, если люди хотели обучить ИИ, им приходилось создавать обучающий набор данных с парами «вопрос-ответ» (данные для маркировки), как упоминалось выше. Машины, по сути, запоминали только пары «вопрос-ответ», но не «понимали» смысл предложения, что представляет собой огромную разницу между механическим заучиванием и пониманием.

Еще проще понять, что после 2017 года нам нужно будет просто ввести как можно больше текстовых данных, и компьютер автоматически поймет, что мы введем, а нам не придется объяснять ему значение.

Цитата из анонса Трансформера от Google: «Благодаря Трансформерам компьютеры смогут видеть те же узоры, что и люди».

Компания Google любезно опубликовала подробную документацию алгоритма Transformer, сделав её общедоступной. При этом компания предоставила права на открытый исходный код этого алгоритма. Таким образом, всё научное сообщество, занимающееся ИИ, получило выгоду от изобретения Google. Среди них была и компания OpenAI, основанная в 2015 году и добившаяся выдающихся результатов лишь после 2017 года.

После того, как Google анонсировала Transformer, несколько месяцев спустя, первые языковые ИИ, основанные на этом новом алгоритме, стали появляться в больших количествах. В январе 2018 года OpenAI выпустила первый ИИ на базе Transformer, GPT-1, и внедрила его очень быстро, быстрее, чем сама Google.

GPT расшифровывается как Generative Pre-trained Transformer, что означает «Генеративно-предобученная программа-трансформатор».

Этот ИИ GPT был создан с главной целью «генерации слов». В частности, вы будете играть с ним в игру «ассоциации», писать предложение, он его прочитает, а затем, основываясь на знаниях, хранящихся в его памяти, «генерирует слова», чтобы продолжить написанное вами предложение.

Например:

Вы ввели: Вьетнам — это

ChatGPT: Вьетнам — страна, расположенная в Юго-Восточной Азии...

Это, казалось бы, «волшебная» штука: вы пишете предложение в ChatGPT, и он отвечает вам. На самом деле, он не отвечает, а воспроизводит связи слов, используя функцию «Генерация слов», чтобы продолжить смысл предложения, которое вы ввели в чате.

|

GPT-1 — это первое поколение ChatGPT. Этот GPT-1 — довольно небольшой ИИ, небольшой как по размеру, так и по сложности. |

В мире лингвистического ИИ сложность, соответствующая уровню «интеллекта» ИИ, измеряется единицей, называемой гиперпараметрами. Эту концепцию можно приблизительно описать как количество смысловых слоёв, которые ИИ понимает во всех текстах, использованных для его обучения.

Чтобы получить ответы на эти вопросы, ученые OpenAI собрали большой объем текста, написанного человеком.

Для обучения этого ИИ GPT учёные OpenAI собрали большой объём текста, написанного человеком, в основном из Википедии, энциклопедий, крупных и государственных газет. Объём текста составляет около сотен гигабайт, а также сотни миллионов документов. После сбора они очистили и отобрали контент. Затем ИИ прочитал эти документы много-много раз. Каждый раз, считывая этот блок данных, он обнаруживал за этими словами новый смысловой слой. Чем больше раз, тем больше смысловых слоёв.

Искусственный интеллект обучается достигать уровня глубокого понимания письменной речи человека, что приводит к очень серьезной проблеме, решения которой на сегодняшний день нет ни у одного специалиста по искусственному интеллекту.

Вычислите «истина» или «ложь». ИИ не может понять, что такое «истина», а что — «ложь».

ИИ видит множество смысловых слоёв в предложении, но не может «понять, верно оно или неверно». Поскольку понятия «верно» и «неверно» относительны, для людей они хрупки и противоречивы, что даже приводит к конфликтам между людьми.

Кроме того, огромный объем текстовых данных, которые ученые OpenAI собирают для обучения ИИ, не всегда является «правильным», предвзятым и содержит «правильную» информацию в соответствии с человеческими социальными стандартами, поскольку объем данных слишком велик и выходит за рамки их способности к выбору.

Например, они могут собирать тексты, утверждающие, что Земля круглая, а также тексты, утверждающие, что Земля плоская. Данные содержат как истинную, так и ложную информацию. Затем, когда ИИ читает и перечитывает эти тексты, чтобы найти смысловые уровни, он также находит «истинные» и «ложные» значения, но у ИИ нет сознания, чтобы распознать, какое значение — какая информация — истинна, а какое — какая информация — ложна. ИИ просто запоминает всё. Когда его спрашивают позже, он просто отвечает, исходя из этой информации, не различая правильное и неправильное.

Такие компании, как Google, Facebook, IBM и Microsoft, неоднократно заявляли о прорывных разработках в области языкового ИИ для ответа на вопросы, вводимые человеком, но быстро отказались от этой идеи. Вы можете найти статьи об этом в интернете на страницах крупных газет. В основном потому, что ИИ отвечает на некоторые вопросы с предвзятостью, подразумевающей неприемлемое «неправильное» значение с точки зрения современных социальных норм, таких как уважение к полу, уважение к религии, уважение к этнической принадлежности, точность описания произошедших событий, истины, которые люди признали истинными...

Крупные компании придерживаются стандартов точности информации, они считают, что ИИ не может решить проблему восприятия «правильно-неправильно», поэтому лучше не выходить на публику.

|

GPT-3 — то же самое, он также создает абзацы, которые нарушают человеческие стандарты «правильного-неправильного», порой настолько неправильные, что это неприемлемо. |

GPT-3 был на пути к обретению популярности, когда по всему миру разразилась пандемия COVID-19. С середины 2020 года эпидемическая ситуация становилась всё более напряжённой, и информация о пандемии полностью затмила информацию о GPT-3.

AI GPT-3 и OpenAI были забыты общественностью до конца 2022 года. OpenAI решила провести маркетинговую программу, чтобы посмотреть, сможет ли она возродить интерес к языковому ИИ?

Поэтому они модифицировали AI GPT-3 в ChatGPT, сделав его более простым в использовании. Вместо того, чтобы представлять собой веб-сайт, на котором люди вводят слова, редактируют параметры, а затем получают в ответ абзац со связанными словами, ChatGPT представляет собой программу чата с полем чата для ввода вопросов. AI ChatGPT играет в игру «Генерация слов», соединяя слова с этим вопросом, но в форме ответа.

Подведем итог формулы успеха ChatGPT за последний месяц: языковой ИИ, достаточно глубоко обученный для генерации содержательных предложений, которые достаточно убедительны для читателей + неэтичная природа компании, разрабатывающей технологии ИИ + подходящий UI/UX (чат) = ChatGPT.

ИИ может видеть множество смысловых слоев в предложении, но не может «понять, является ли это значение правильным или неправильным».

(Эксперт Нгуен Хонг Фук)