Видео фальшивого наводнения в Кёнбоккуне, снятое с помощью искусственного интеллекта, шокирует и вызывает опасения по поводу манипуляции информацией

Бурное развитие технологий генерации видео на основе искусственного интеллекта создает серьезную проблему для фейковых новостей в Южной Корее: в сети стал вирусным видеоролик, имитирующий затопленный дворец Кёнбоккун.

Видеозапись наводнения во дворце Кёнбоккун, снятая искусственным интеллектом, шокировала общественное мнение

Видео, созданное с помощью искусственного интеллекта (ИИ), имитирующее сцену погружения дворца Кёнбоккун в Сеуле под воду, вызвало переполох в корейском интернет-сообществе.

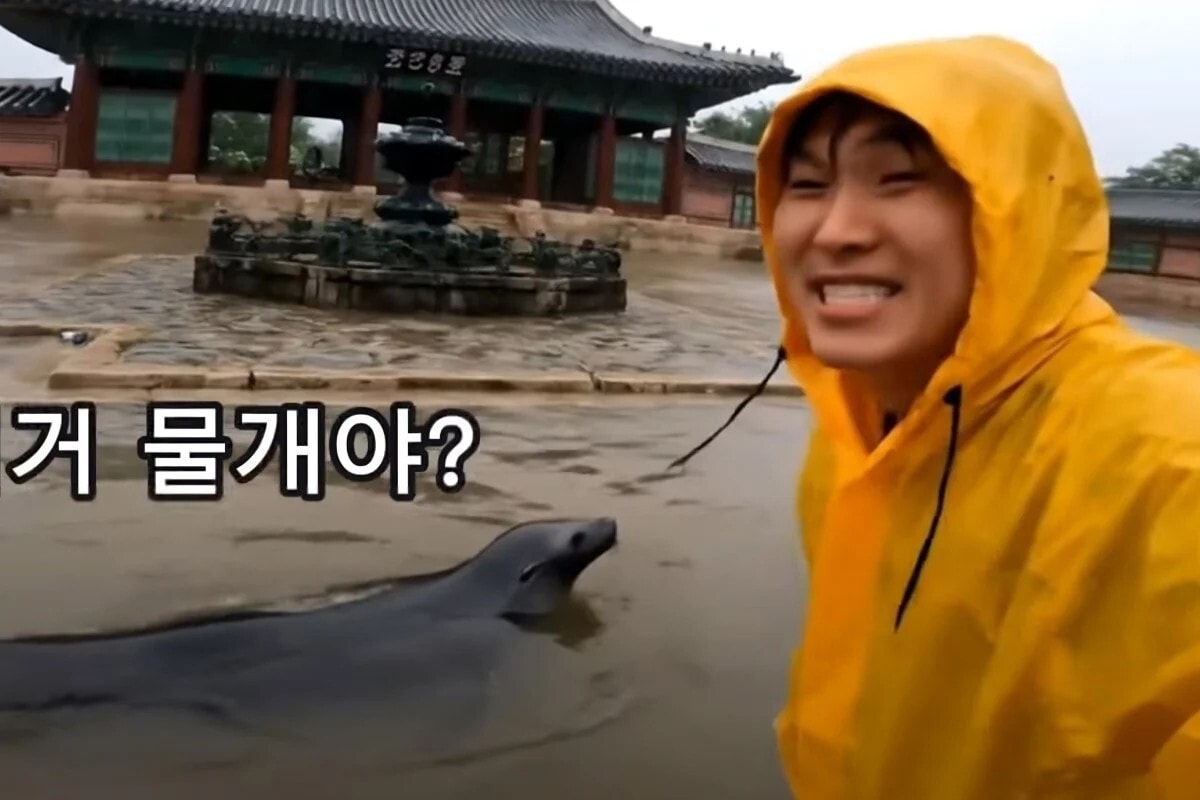

Клип, опубликованный на YouTube-канале «Golpadak», начинается с того, что мужчина в жёлтом плаще стоит перед дворцом и говорит: «Льёт так сильно… Кёнбоккун полностью затоплен». Далее следуют кадры, где люди вычерпывают воду вёдрами, и даже тюлень скользит по территории дворца.

Несмотря на абсурдные детали, видео все равно заставило многих поверить в его реальность, поскольку оно совпало по времени с рекордно сильными дождями в Сеуле.

Позже было подтверждено, что видео создано с помощью Google Veo 3, который позволяет создавать реалистичные изображения и реалистичные диалоги. Многие выразили возмущение, заявив, что создателя следует наказать за преднамеренное распространение ложной информации.

Проблемы дипфейков и проблемы контроля информации

Инцидент с фейковым видео о наводнении в Кёнбоккуне — не единичный случай. Десятки подобных фейковых видеороликов о наводнении появились на YouTube, вызвав бурную реакцию СМИ и экспертов. Они предупреждают, что общественность всё чаще становится жертвой обмана, создаваемого искусственным интеллектом, даже если детали в видеороликах несколько абсурдны.

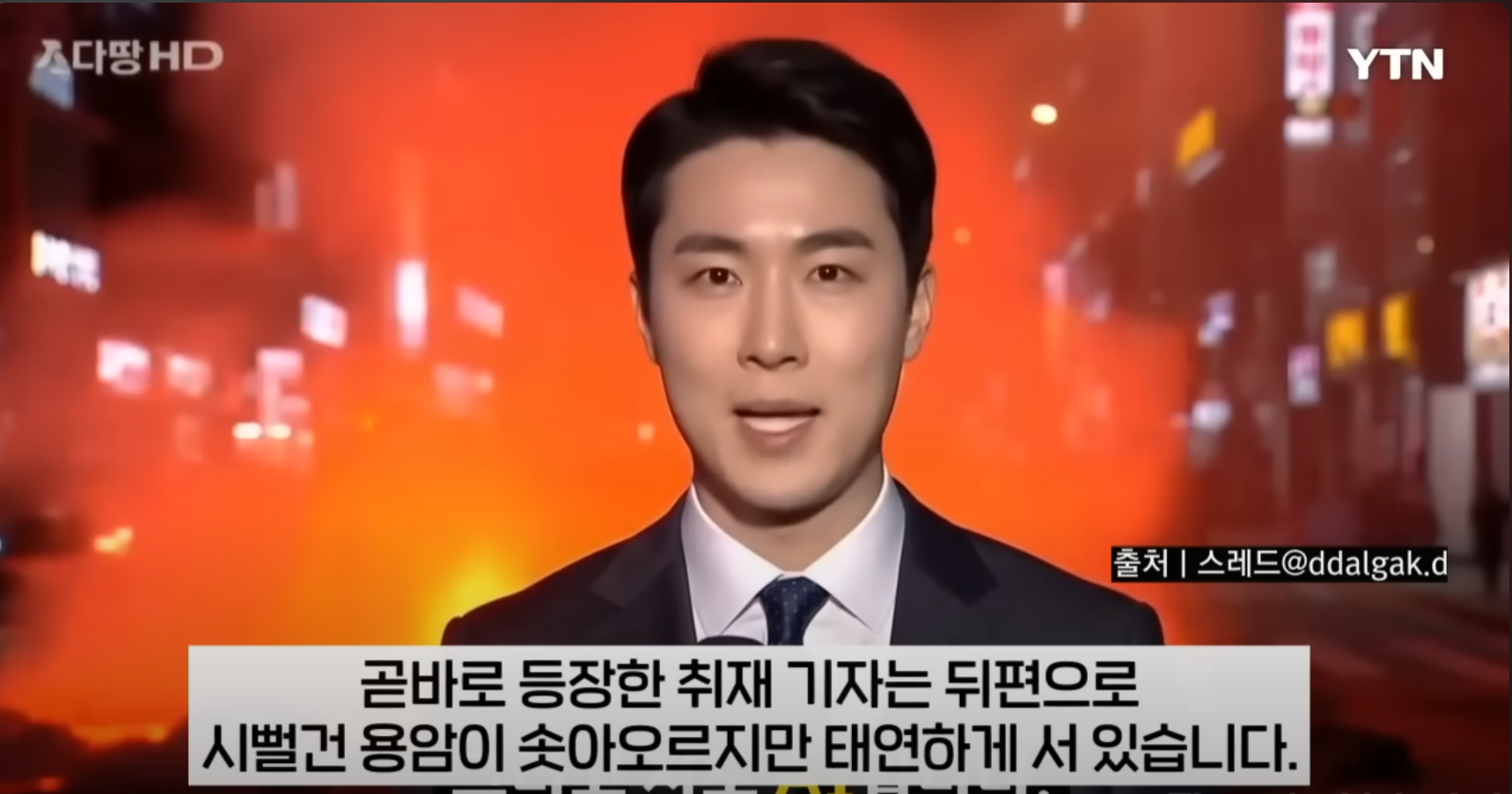

Ранее другое фейковое видео, имитирующее поток лавы в центре Сеула, также вызвало недоумение у зрителей. Создатель этого видео, ютубер «Ddalgak», заявил, что его цель — высмеять доверчивость интернет-пользователей в отношении онлайн-контента. Он также признался, что использовал Veo 3 для создания видео, вдохновлённого мошенничеством с использованием deepfake Илона Маска.

Южная Корея усиливает контроль: Закон об искусственном интеллекте и лазейки

В ответ на широко распространённую волну дипфейков Южная Корея приняла «Основной закон об искусственном интеллекте», который вступит в силу в январе 2026 года. Этот закон требует, чтобы все видеоролики, созданные с использованием искусственного интеллекта, были снабжены водяными знаками, чтобы зрители могли легко их идентифицировать. Однако эксперты обеспокоены тем, что водяные знаки можно легко удалить или отредактировать, что снижает сдерживающий эффект этой меры.

Г-н Чхве Бён Хо, эксперт Института исследований искусственного интеллекта Корейского университета, прокомментировал: «Если компании, занимающиеся ИИ, разработают технологию, помогающую выявлять фейковый контент, это снизит социальные издержки и будет более эффективным, чем административные меры».

Дипфейк: от развлечения до мошенничества и политических манипуляций

Дипфейки больше не являются просто развлечением или сатирой, а становятся инструментом серьёзной противозаконной деятельности. Они используются для создания оскорбительного контента без согласия, финансового мошенничества и даже политических манипуляций.

Во время прошлогодних выборов в Национальное собрание национальное избирательное агентство Южной Кореи обнаружило и обработало более 120 фейковых изображений и видео, созданных с помощью искусственного интеллекта. Это привело к введению чёткого требования о раскрытии информации об использовании искусственного интеллекта в предвыборной кампании для обеспечения прозрачности и честности для избирателей.

Стремительное развитие технологии deepfake требует более эффективных мер контроля и идентификации для защиты людей от дезинформации и потенциального мошенничества.