5 个技巧助您检测虚假 AI 生成内容

近年来,人工智能生成的视频数量激增,真假界限也变得模糊。为了避免上当受骗,以下是一些简单的技巧,帮助你辨别哪些内容值得信赖。

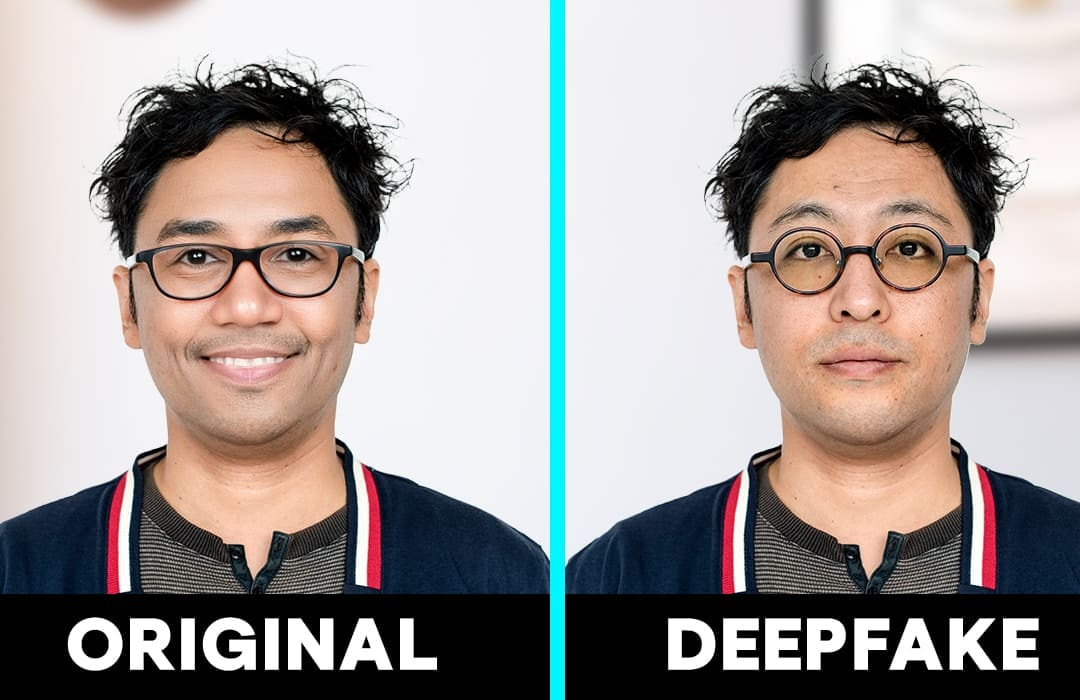

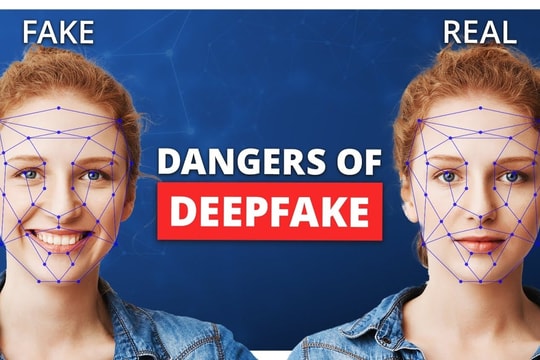

随着人工智能飞速发展,区分网络内容的真假变得越来越困难。不仅是静态图像,得益于 OpenAI 的 Sora 和谷歌的 Veo 等工具,AI 生成的视频也呈现爆炸式增长。这使得区分事实与虚构成为一项巨大的挑战。

目前,除了专门检测深度伪造视频的软件外,AI 生成的视频检测软件功能有限。因此,我们很大程度上只能依靠自身的观察能力和敏锐的洞察力。以下是一些可以帮助人们识别 AI 生成的伪造视频的关键特征。

1. 人工智能生成的虚假视频通常不遵循物理定律

识别虚假AI视频最简单的方法之一,就是看它是否遵循物理定律。在现实世界中,玻璃不会悬浮,液体也不会穿过固体物体,但OpenAI的Sora却能做到这些荒谬的事情。

就连 OpenAI 也承认,Sora 无法准确模拟像玻璃破碎这样的基本交互。观看视频时,务必密切关注主要动作和背景细节,以发现任何异常。

另外,听从你的直觉。如果你觉得某些东西“不对劲”,即使你无法用语言表达,也可能表明该视频是人工智能生成的。

2. 仔细观察周围世界的反应。

周围世界的反应也是识别AI视频的重要标志。在现实生活中,咬一口苹果应该会让它消失,但在Sora的世界里,情况并非如此。

OpenAI 承认,像进食这样的互动有时不会对物体的状态产生完全相同的变化。因此,观看视频时,不仅需要关注动作本身,还需要关注随之而来的反应,即物理后果,即环境或物体的变化。

例如,一个人在沙地上行走,但没有留下新的脚印,或者水洒在地板上,但地板保持干燥,没有任何污渍。

3. 在视频中看到任何异常吗?

你是否有过这样的经历:看完一段视频后,感觉“哪里不对劲”,但又一时想不出来是什么地方?这是观看 AI 生成的视频时常见的体验。

异常可能很明显,但有时只是一个转瞬即逝、模糊的细节,让你停下来问自己:“哪个时刻让我感到不舒服?”正是这些小细节,往往揭示出AI构建的虚拟世界运行逻辑的不一致之处。

例如,在一个视频中,我们看到一只手正在仔细地描绘一枝樱花。笔触不断移动,画面逐渐显现,但奇怪的是,尽管画笔从未再次浸入调色板,笔触的颜色却突然发生了变化。这是一个典型的“细微错误”,需要观众保持警惕才能注意到。

4. 尝试通过重新创建视频进行“反向追踪”

帮助用户评估人工智能生成视频真实性的另一种方法是通过重新制作视频尝试“回溯”。

Midjourney 图像转文本生成器的爱好者们一直在尝试一种“反向追踪”的方法。他们仔细观察 Sora 生成的视频,然后重写接近原始素材的描述,并将其输入 Midjourney 工具中,从而生成静态图像。

结果表明,在很多情况下,Sora 的视频只是“动态的旅途照片”。这体现了图像生成和视频生成模型之间的紧密联系,也引发了人们对 Sora 真实创造力水平的质疑。

如果你想在分析视频时更多地运用感官,可以尝试类似的方法。想象一下你认为可能是该场景的描述,然后用文本转图像工具运行它,看看它有多相似。

接下来,用谷歌搜索一下,看看这段视频是否来自任何公开数据。这种方法并不完美,但它可以作为判断你看到的是真实视频还是人工智能创作的“指南针”。

5. 时刻保持警惕,更新你的技术知识

AI 文本视频制作技术尚处于起步阶段,但发展速度极快。在短时间内,AI 模型就能制作出细节丰富、令人难以辨别真假的视频。

这意味着被人工智能生成的内容欺骗的风险正在增加。避免成为受害者的最佳方法是学会与技术“同步进化”,这意味着要不断更新知识,关注新工具,并练习图像和音频分析技能。

.jpg)