Avertissement sur le problème croissant de la fausse pornographie à l'ère de l'IA

Avec le développement rapide de l'intelligence artificielle (IA), le problème des deepfakes pornographiques s'accroît à un rythme alarmant. Les experts alertent sur le fait que le développement de ces technologies est exploité pour créer de faux contenus pornographiques, causant de graves dommages aux victimes et à la société.

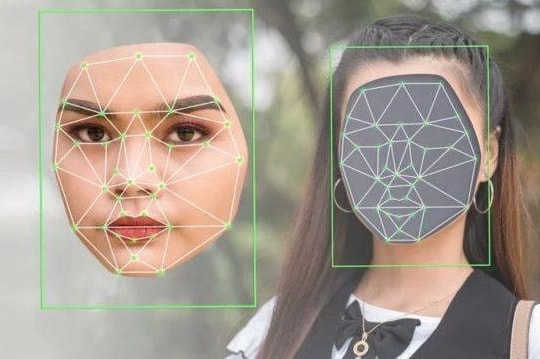

Le deepfake porn est l'utilisation de la technologie de l'IA pour créer ou éditer des vidéos, des images ou du contenu pornographiques, dans lesquels le visage ou le corps d'une personne est composé ou édité pour apparaître comme si elle se livrait à des actes ou à des situations sexuellement explicites qui ne le sont pas.

Les progrès des outils d’IA ont rendu plus facile que jamais la création et la diffusion d’images pornographiques deepfake sans le consentement de la victime.

« Tout être humain peut être victime de deepfake porno. » C'est ainsi que Carrie Goldberg, avocate américaine spécialisée dans les crimes sexuels et la protection de la vie privée en ligne, décrit les risques que représente le deepfake porno à l'ère de l'IA, où n'importe qui peut être exploité sans même le savoir.

La vengeance pornographique, le partage d'images sexuellement explicites sans consentement, existe depuis la création d'Internet. Cependant, l'essor des outils d'IA a accru les risques et élargi le public cible de cette forme de harcèlement.

Aujourd'hui, n'importe qui peut être victime d'un tel acte, même sans avoir jamais pris ou envoyé de photo de nu. Les outils d'IA modernes sont capables de superposer le visage d'une personne sur un corps nu ou de retoucher des photos existantes pour donner l'impression que la victime est nue, même lorsque c'est le contraire.

Au cours de l'année écoulée, des images pornographiques non consensuelles générées par l'IA ont ciblé un large éventail de personnes, des femmes célèbres aux lycéennes. La diversité des victimes illustre l'ampleur de cette forme de harcèlement toxique et montre que n'importe qui peut en être victime.

Découvrir que vous ou votre enfant avez été la cible de deepfakes pornographiques est souvent une expérience terrifiante et déprimante, explique Carrie Goldberg. « C'est particulièrement effrayant pour les jeunes qui ne savent pas comment y faire face. Internet, avec son immensité et son ambiguïté, peut être un lieu rempli de menaces », ajoute-t-elle.

Alors que les entreprises technologiques et les législateurs s'efforcent de lutter contre ce fléau, ces outils restent largement disponibles. Alors, que pouvez-vous faire pour vous protéger et protéger vos proches ?

Carrie Goldberg donne quelques conseils importants pour faire face à cette menace. Ainsi, si vous êtes la cible de pornographie générée par l'IA, la première chose à faire est de faire une capture d'écran. Cela permet de préserver des preuves importantes, de soutenir la procédure judiciaire et de protéger les droits des victimes.

Ensuite, les victimes peuvent rechercher et utiliser les formulaires fournis par les principales plateformes de médias sociaux comme Google, Meta et Snapchat pour demander la suppression des images pornographiques diffusées.

De plus, des organisations à but non lucratif comme StopNCII.org et Take It Down proposent une assistance pour gérer les demandes de suppression de contenu sur plusieurs plateformes, mais Goldberg note que tous les sites ne coopèrent pas avec ces groupes, ce qui rend les suppressions d'images parfois plus compliquées.

Aux États-Unis, un groupe d’adolescents et de parents victimes de pornographie générée par l’IA se sont présentés lors d’une audience au Capitole pour partager leurs histoires.

Lors de l'audience, le sénateur républicain Ted Cruz a présenté un projet de loi qui a reçu le soutien de la sénatrice démocrate Amy Klobuchar et de nombreux autres collègues.

Le projet de loi proposé criminaliserait la distribution d’images pornographiques générées par l’IA sans consentement et obligerait les plateformes de médias sociaux à supprimer le contenu dès réception de la demande d’une victime, une étape majeure vers la protection de la vie privée et la prévention du harcèlement numérique.

Mais les victimes sont souvent contraintes de naviguer entre les complexités et les chevauchements des lois des États. Dans certaines régions, il n'existe aucune loi pénale claire interdisant la création ou la diffusion de contenu pornographique deepfake pour adultes, ce qui complique la recherche de justice.

L'avocat Goldberg a déclaré avec franchise : « Mon conseil ne s'adresse pas seulement aux victimes, mais aussi à ceux qui ont l'intention de commettre des crimes : ne soyez pas lâches, ne volez pas l'image des autres et ne la transformez pas en outil pour les humilier. »

Elle a souligné que même si les victimes ont peu de moyens d'empêcher complètement ces comportements, en particulier dans une société numérique en constante évolution, la sécurité et le respect en ligne dépendent toujours du sens moral de chacun : « Nous ne pouvons pas obtenir une protection absolue, mais ne pas être un connard est entièrement la responsabilité de chaque individu. »