警告人工智能时代虚假色情问题日益严重

随着人工智能(AI)的快速发展,深度伪造色情内容问题正以惊人的速度增长。专家警告称,深度伪造技术的发展正被用于制作虚假色情内容,对受害者和社会造成严重危害。

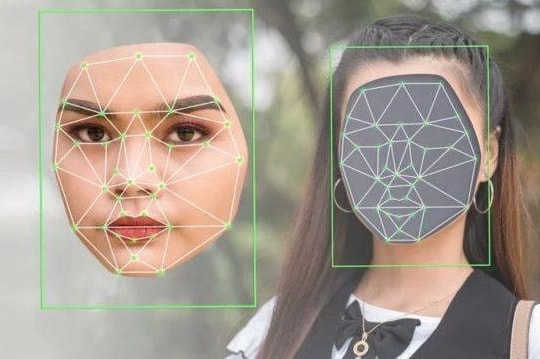

Deepfake 色情是利用人工智能技术制作或编辑色情视频、图像或内容,将人物的面部或身体合成或编辑成看起来好像他们正在进行实际上并不存在的性暴露行为或场景。

人工智能工具的进步使得在未经受害者同意的情况下制作和传播色情深度伪造图像变得比以往任何时候都更加容易。

“任何人类都可能成为深度伪造色情片的受害者。”美国专门从事性犯罪和网络隐私的律师凯莉·戈德堡 (Carrie Goldberg) 这样描述深度伪造色情片在人工智能时代带来的风险,任何人都可能在不知情的情况下被利用。

报复性色情,即未经同意分享色情图片的行为,自互联网诞生以来就一直存在。然而,人工智能工具的爆炸式增长增加了这种骚扰形式的风险,并扩大了其目标受众。

如今,任何人都可能成为受害者,即使他们从未拍摄或发送过裸照。现代人工智能工具能够将人脸叠加到裸体上,或编辑现有照片,使受害者看起来像是裸体,即使事实并非如此。

过去一年,未经同意的人工智能生成的色情图片攻击了形形色色的人群,从名人女性到高中女生,不一而足。受害者的多样性表明,这种恶意骚扰形式非常普遍,任何人都可能成为受害者。

凯莉·戈德堡表示,发现自己或孩子成为深度伪造色情内容的受害者,往往是一段令人恐惧和沮丧的经历。“对于那些不知道如何应对的年轻人来说,这尤其可怕。互联网的广阔性和模糊性,可能是一个充满威胁的地方,”她说。

尽管科技公司和立法者正在努力打击这种病毒,但现实是这些工具仍然随处可见。那么,你该如何保护自己和亲人呢?

Carrie Goldberg 就如何应对这一威胁提出了一些重要建议。例如,如果你成为人工智能生成的色情内容的目标,第一步就是截屏。这有助于保存重要证据,支持法律程序,并保护受害者的权利。

接下来,受害者可以搜索并使用 Google、Meta 和 Snapchat 等主要社交媒体平台提供的表格来请求删除分发的色情图片。

此外,StopNCII.org 和 Take It Down 等非营利组织也提供跨多个平台处理内容删除请求的帮助,但 Goldberg 指出,并非所有网站都与这些组织合作,这使得图片删除有时会变得更加复杂。

在美国,一群遭受人工智能色情内容侵害的青少年和家长出现在国会山的听证会上,分享他们的故事。

听证会上,共和党参议员特德·克鲁兹提出一项法案,得到了民主党参议员艾米·克洛布查尔等多位同事的支持。

拟议的法案将传播未经同意的人工智能生成的色情图片定为犯罪,并要求社交媒体平台在收到受害者的请求后删除内容,这是保护隐私和防止数字骚扰的重要一步。

但受害者往往不得不面对州法律的复杂性和重叠性。在某些地区,没有明确的刑事法规来阻止成人相关的深度伪造色情内容的制作或传播,这使得寻求正义的过程变得充满挑战。

戈德堡律师坦言:“我的建议不仅针对受害者,也针对那些有意犯罪的人:不要做懦夫,不要窃取他人图像,并将其变成羞辱他人的工具。”

她强调,虽然受害者几乎没有办法完全阻止这些行为,尤其是在不断发展的数字社会中,但网络安全和尊重仍然取决于每个人的道德感:“我们无法实现绝对的保护,但不做混蛋完全是每个人的责任。”